Archivo de la categoría: Hyper-V

Examen 74-409 Server Virtualization with Windows Server 2012 R2 Hyper-V and System Center….. Pasado!!

Muy buenos dias, Hoy otro «Post Express».

Hace unos meses, a través de Born To Learn Blog, descubrí que Microsoft ofertaba realizar el examen de «Server Virtualization with Windows Server Hyper-V and System Center» (74-409), gratuitamente antes de finales de Junio del presente año. Ni corto ni perezoso consegui un Voucher y, después de múltiples vicisitudes, incidencias, olvidos, cambios de última hora, al final, esta mañana he realizado el examen.

El examen se divide en cuatro partes principales con el consiguiente porcentaje de puntuación:

- Configure Hyper-V (30-40%)

- Configure and Manage Virtual Machine High Availability (15-20%)

- Implement a Server Virtualization Infrastructure (35-40%)

- Monitor and Maintain a Server Virtualization Infrastructure (15-20%)

Ademas, se incluyen preguntas sobre productos tales como System Center Operation Manager, System Center Data Protection Manager o Windows Azure. Vamos que no tiene desperdicio. Muy completo.

Lecturas recomendadas:

- Anders Eide Blog – MS Exam 74-409.

- Microsoft Virtual Academy : Server Virtualization wth Windows Server Hyper-V and System Center.

- Osford SBS Guy – Training Resources for 74-409.

Ahora, el descanso del guerrero …. o no. Como siempre, os recomiendo la Certificación Oficial en cualquiera de los Sistemas con los que estéis trabajando o estudiando, no solo con vistas a conseguir un puesto de trabajo digno (sé que está complicado pero irá mejorando, espero), un ascenso o reconocimiento en el actual, un salto cualitativo a uno nuevo y mejor, pero sobre todo por la satisfacción personal de conseguir nuestras metas, nuestros objetivos, nuestros sueños. Paso a paso, «caminante no hay camino, se hace camino al andar», decía Antonio Machado, de haí el título de este Blog, «El Camino de un ITPro», el «Camino del Guerrero» (Bushido), el «Camino del Samuray».

Mañana, mas de powershell, de GPOs de Directorio Activo, de tareas programadas, etc. Buena semana a todos.

Cómo crear un cluster Windows Server 2008 R2 sobre Hipervisor vSphere 5. Creación y preparación de Servidores.

Uno de mis últimos proyectos es montar un nuevo servicio de Servidor de Ficheros en la empresa en la que estoy trabajando. He tratado de mil formas de montarlo con Windows Server 2012 R2 pero al final vamos a montarlo con Windows 2008 R2. Os dejo algunas de las muchas ventajas que tiene uno sobre el otro:

Uno de mis últimos proyectos es montar un nuevo servicio de Servidor de Ficheros en la empresa en la que estoy trabajando. He tratado de mil formas de montarlo con Windows Server 2012 R2 pero al final vamos a montarlo con Windows 2008 R2. Os dejo algunas de las muchas ventajas que tiene uno sobre el otro:

- SMB 3.0.

- Dynamic Access Control (DAC)

- Deduplicación.

- Storage Spaces

- PowerShell 3.0

- Server Manager.

- Mejoras en DFS Namespaces y DFS replication.

Por otro lado, antes de montar este clúster conviene leerse la documentación oficial y algún que otro blog de Vmware, Hyper-V, RHEL o XenServer para crear un Failover Cluster de Microsoft sobre plataformas de virtualización. Os dejo este link con el documento de vmware vSphere 5.

Este sería un gráfico típico de un Cluster entre dos servidores virtuales situados en distintos hosts de virtualización:

En este ejemplo, he creado en nuestra plataforma de virtualización de Vmware Vsphere 5.5 los 2 servidores con las siguientes características:

FILESHAREA.rob.com

- DATASTORE: 69 HITACHI AMS2300

- Nodo del Cluster: ESXIPO.rob.com

- Disco C: 40 GB

- 4 GB de memoria RAM

- 4 vCPU

- NIC’S:

- NIC 0: PUBLIC IP: por ejemplo 10.11.0.117

- NIC 1: PRIVATE IP: por ejemplo 192.168.0.1

- Instalación de parches de seguridad hasta el día de la fecha.

FILESHAREB.bme.com

- DATASTORE: 17 HITACHI AMS2300

- Nodo del Cluster: ESXIPM.rob.com

- Disco C: 40 GB

- 4 GB de memoria RAM

- 4 vCPU

- NIC’S:

- NIC 0: PUBLIC IP: por ejemplo 10.11.0..118

- NIC 1: PRIVATE IP: por ejemplo 192.168.0.2

- Instalación de parches de seguridad hasta el día de la fecha.

Instalamos los 2 servidores Virtuales con Windows Server 2008 R2 Enterprise o Datacenter de una forma limpia. Lo ideal es tirar de alguna plantilla ya creada pero para los menos organizados hacemos una instalación nueva. Podemos crearlos en cualquiera de las dos versiones, o ServerCore, mucho mas limpia y sin sobrecarga de la interface gráfica (GUI), o con la versión con GUI. Dependerá de nuestras necesidades y de nuestros recursos.

Como habeis podido observar, dispongo de una cabina de discos HITACHI AMS2300, donde mostraremos a nuestros Host de virtualización las siguientes LUNs:

- Quorum.- Suele ser de unos 500 MB, mínimo.

- Datos.- Vamos a mostrar una de 500 GB.

Entramos en la configuración de cada servidor de ficheros y añadimos un nuevo disco:

Indicamos que va a ser un disco en modo RAW:

Nos aparecerán las LUNs que desde Almacenamiento nos han mostrado, la de 500 MB y la de 500 GB:

Seleccionamos que queremos realizar el mapeo de la LUN en un disco VMDK y que se aloje en el mismo DataStore donde reside el Servidor:

Posteriormente, seleccionamos el modo de compatibilidad, en nuestro caso como lo vamos a tratar como si fuese un servidor físico con su controladora, seleccionaremos «Fisico»:

Y, para terminar, seleccionaremos el drive SCSI que no deberá estar utilizado por Vmware. En nuestro caso hemos utilizado las SCSI (1:0 y 1:1). Posteriormente, en la configuración del resto de nodos necesitaremos esta información:

Apuntaremos (Siguiendo recomendaciones de Vmware para no utilizar el puerto SCSI 0) :

- SCSI 1:0 Para el disco de Quorum.

- SCSI 1:1 Para el disco de Datos.

Una vez realizada esta selección nos aparecerá la pantalla de resumen y …. ya tendremos mapeadas las LUNs al servidor. Podremos ver que nos han aparecido tanto el nuevo disco como un nuevo controlador SCSI y, al ser Windows Server 2008 R2, es LSI Logic SAS:

Y, ojo, con la política de compartir discos virtuales ya que, normalmente, se queda en «none» y, como comprendereis, para nuestro ejemplo tiene que estar en «Physical»:

Todo esto habrá que hacerlo para todos y cada uno de los servidores que vamos a incluir en nuestro Cluster. Una vez dentro de la configuración del siguiente nodo del cluster en la consola del Virtual Center, procederemos a añadir el nuevo hardware y en todos estos nuevos nodos, seleccionaremos la siguiente opción para el tipo de disco:

Seleccionaremos uno por uno cada discos que se han «mapeado», que en nuestro caso los ha renombrado a FILESHAREA.ROB.com_1.vmdk y FILESHAREA.ROB.com_2.vmdk:

Volvemos a seleccionar los nodos SCSI virtuales:

Y nos aparecerá la ventana de resumen. Continuaremos seleccionado cada uno de los discos, que estarán en el Datastore en donde esté alojado el servidor que previamente hemos configurado así como el controlador SCSI que pertenece a cada uno de los discos que hemos añadido al mapeo de LUN. Comprobamos que la configuración SCSI está indicada en Physical.

Una vez terminado, podemos visualizar en ambos nodos del cluster que aparecen los discos para la creación del Cluster:

Para terminar, tenemos que recordar que hay que crear una regla de «Anti-Afinidad» para que no estén los dos nodos del cluster en el mismo Host de virtualización. Desde nuestro Virtual Center, nos situamos sobre el Cluster de Hosts de virtualización, botón derecho y «Editar propiedades».

Seleccionamos la regla y creamos una que vamos a denominar «Anti-Afinidad nodos del Cluster de ficheros», para que no estén ambos nodos del Cluster en el mismo host de virtualización. En el tipo seleccionaremos en nuestro caso «Separar Máquinas Virtuales» y seleccionaremos nuestros servidores:

Normalmente estas reglas tienen que funcionar pero si queremos asegurarnos del estricto cumplimiento de las reglas de afinidad, tenemos que seguir el siguiente procedimiento:

En opciones avanzadas de la configuración del servicio DRS de nuestro Cluster de Hosts de virtualización incluiremos una clave denominada ForceAffinePoweron con el valor de 1.

Ya tenemos preparado nuestros servidores con Windows Server 2008 R2 dispuesto a crear la semana que viene el Cluster de Ficheros con servicio DFS.

Buen fin de semana, jejeje.

Bibliografia:

Afinar la configuración de nuestro Cluster Hyper-V Windows 2012. Mejoras al modelo de Quorum.

Para terminar esta larga saga de afinación de nuestro Cluster Hyper-V con Windows Server 2012, hoy comento las mejoras en el modelo de Quorum.

Recordamos que en un Cluster, el Quorum o Testigo es quien se va a encargar de que todos los nodos trabajen de forma controlada, y de que ninguno tome posesión o intente proporcionar un servicio para el cual no esta autorizado en cada momento.No tenemos que olvidar que el Quroum en un cluster, nos tiene que servir de ayuda o apoyo para lograr un consenso o mayoría de votos (que de eso se trata) entre todos los nodos de dicho cluster.

Os hago un simple y rápido recordatorio de cuándo usar un testigo y tipos de ellos:

¿Cuando usar Testigo? La diferencia en usarlo o no, principalmente, es en el número de nodos que se necesitan vivos, para que el servicio permanezca activo.

- Cuando el número de nodos es par, se aconseja usar testigo.

- Cuando el número de nodos es impar, no se necesita usar testigo, aunque podemos hacerlo.

¿Tipo de Testigos? Hay dos tipos; de disco o de recurso de red.

- Disco.- Se suele tener un disco de un tamaño significativo, normalmente entre 500 MB y 1 GB, en formato NTFS o ReFs, dedicado exclusivamente (LUN), para guardar una copia actualizada del estado del cluster. Dicho disco podrá balancearse entre cualquiera de los nodos activos y todos y cada uno de ellos tendrán acceso.

- Recurso de Red.- Nos permite una implementación más rápida que el model anterior y consiste en un Share o carpeta compartida, el cuál no tiene que estar en ninguno de los nodos componentes del cluster, incluso, dependiendo de nuestras necesidades, ni en el site principal, o el secundario.

Como todo en este mundo tienen unas ventajas y unos inconvenientes y serán óptimos de aplicar uno u otros dependiendo del tipo de servicio que queramos implantar, de los escenario en el que nos movamos. etc., etc., ya que la finalidad del Cluster es la de que «siempre se esté dando servicio».

Las principales mejoras al modelo de Quorum incluidas en Windows Server 2012 son:

- Node vote Weight.- Se trata de administrar y tener un control sobre que nodos nos interesa que tengan voto y aquellos nodos que no nos interese que tengan voto. Esta situación es óptima para configuraciones Multisite.

- Dynamic Quorum.- Habilitada por defecto, permite al propio Cluster administrar el Quorum, tomando sus propias decisiones, dependiendo de las circunstancias. Por ejemplo, en el caso de caida de uno o varios nodos, el número de votos requerido para alcanzar el consenso varia, permitiendo sobrevivr al cluster ante caidas de mas del 50% de nodos.

Configurar el Quorum del cluster

Ya hablamos de cómo configurar el Quorum en Windows Server 2012 e Hyper-V desde la consola de gestión en el Post Cluster Hyper-V – Configuración del tipo de Quorum. Asi que poco que aportar.

Nos queda la otra opción, nuestra amiga Powershell.

Ejecutando el siguiente cmdlet obtendremos todas la información de las propiedades del cluster:

Get-Cluster | Format-List -Property *

Donde podríamos activar el Quorum dinamico, tecleando:

(Get-Cluster).DynamicQuorum = 1

Aqui os dejo un muy buen Video/wibinar de Juan Jose Diaz Antuña explicativo del rol Failover Cluster para Windows Server 2012.

Para mas información, su blog y su twitter: @diazantuna

Para finalizar, me gustaría comentaros una nueva característica que nos aparece en el reciente Windows Server 2012 R2: Force Quorum Resiliency:

Si tenemos un cluster extendido en varios Sitios o Datacenters, separados geográficamente, podemos establecer uno de ellos como autorizativo (denominado ForceQuorum). De esta manera podemos decidir que información del cluster y de qué sitio podrá ser usada o prevalecerá cuando ocurra una situación de «cerebro divido», o sea, que cada sitio crea que el otro está caido y se queden con los recursos del cluster, aunque, en verdad, ambos están levantados pero incomunicados entre si.

Una vez la conexión entre ambos sites se restablezca, los nodos del cluster se pueden reiniciar y volver a unirse a nuestro cluster.

Otros links de interes:

Afinar la configuración de nuestro Cluster Hyper-V Windows 2012. Reglas de Afinidad y Antiafinidad a traves de Powershell.

Sigo cerrando posts sobre Hyper-V y Windows 2012 que tenía pendientes. En este caso afinación de configuración.

Como continuación al Post sobre la afinación en la configuración de nuestro Cluster Hyper-V Windows 2012 (este), dejamos pendiente la configuración a través de Powershell dividida en las siguientes partes, Preferred Owners, Proceso de Failover, Mejoras en el Orden de arranque de las VM y Reglas de Afinidad y Antiafinidad.

AFINIDAD Y ANTI-AFINIDAD

Para empezar debemos entender que son y cómo funcionan este tipo de reglas.

- Reglas de afinidad VM – VM ==> Mantener ejecutándose juntas en el mismo Host.

- Reglas de anti-afinidad VM – VM ==> Mantener ejecutándose siempre separadas en distintos Hosts.

Parace complejo pero con un ejemplo claro lo vais a ver. ¿Queremos que los Controladores de Dominio se ejecuten todos en el mismo Host de virtualización? ¿Qué pasaría si se nos cae dicho host? Adios dominio. Otro ejemplo, tenemos dos servidores que consumen mas del 50% de la memoria RAM de un Host ¿Queremos tenerlos trabajando juntos sobre el mismo hosts? ¿Podemos?

Centrándonos sobre todo en reglas de Anti-afinidad, para Hyper-V utilizaremos la propiedad AntiAffinityClassNames (paradójicamente existe desde Windows Server 2003). A dicha propiedad no se puede acceder desde la consola de gestión de Failover Cluster pero si desde nuestro gran amigo y ya compañeros Powershell. La forma de interactuar sobre dicha propiedad nos va a dar diversas posibilidades. Yo os las ordeno de mas fácil a más complicada, según mi criterio.

Script de Powershell Configure-AntiAffinity.ps1.

Michel de Rooij, para facilitarnos el trabajo, ha escrito el siguiente scritp de powershell que nos permite configurar la anti-afinidad, Configure-AntiAffinity.ps1. Como ejemplo, no queremos que ninguno de los controladores de nuestro dominio, robezno.com, estén en el mismo Host de virtualización:

Configure-AntiAffinity.ps1 -Cluster Hyper-VCluster.robezno.com -Groups dc01.robezno.com, dc01.robezno.com, dc01.robezno.com -Class DCAntiAffinity -Verbose

Explicamos los parámetros a configurar:

- Cluster.- especificamos el cluster en el que queremos crear la regla.

- Groups.- especificamos los Cluster Groups (o sea, las VM) que queremos configurar.

- Class.- Podemos poner un nombre a la regla.

Resto de opciones.-

Repetimos nuestro ejemplo con los controladores de dominio.

- Cluster.exe.- Esta opción fue despreciada desde Windows Server 2008 R2. Lo que hacemos es configurar la propiedad AntiAffinityClassNames. Sería:

cluster.exe group «dc01.robezno.com» /prop AntiAffinityClassNames=»DCAntiAffinity»

cluster.exe group «dc02.robezno.com» /prop AntiAffinityClassNames=»DCAntiAffinity»

cluster.exe group «dc03.robezno.com» /prop AntiAffinityClassNames=»DCAntiAffinity»

- Powershell.- Nuevamente configuraremos la propiedad AntiAffinityClassNames directamente. Os dejo unos ejemplos, el nuestro de los Controladores de dominio y otro de un grupo de Anti-Afinidad cuando tenemos varios servidores de ficheros formando un cluster:

(Get-ClusterGroup dc01.robezno.com).AntiAffinityClassNames = «Domain Controlers»

(Get-ClusterGroup fs03.robezno.com).AntiAffinityClassNames = «File Servers»

(Get-ClusterGroup dc01.robezno.com).AntiAffinityClassNames += «File Servers»

- Hyper-V Server o Server Core.- Os dejo diversos ejemplos, el de Controladores de dominios, el de poder incluir una VM en varios grupos de anti-afinidad, o el de restablecer o resetear dicha anti-afinidad.

DISM /ONLINE /ENABLE-FEATURE /FEATURENAME:FailoverCluster-CmdInterface

cluster group dc01.robezno.com /prop AntiAffinityClassNames = «Domain Controlers»

cluster group xxxx /prop AntiAffinityClassNames = «Domain Controlers»,»Critical Servers»

cluster group xxxx /prop AntiAffinityClassNames = «»

- System Center Virtual Machine Manager 2012 con Service Pack 1.- Lo realizaremos desde la consola de gestión. Hardware Configuration ==> Advanced and Availability. Pulsaremos el botón de Manage availability sets y crearemos nuestra regla:

- Windows Server 2012 R2 con Hyper-V.- Tengo que comprobar cómo está configurado este parámetro para Hyper-V 2012 R2…… ¿tal vez ya esté integrado en la consola de Hyper-V?

Hasta la vista, babe.

Bibliografia

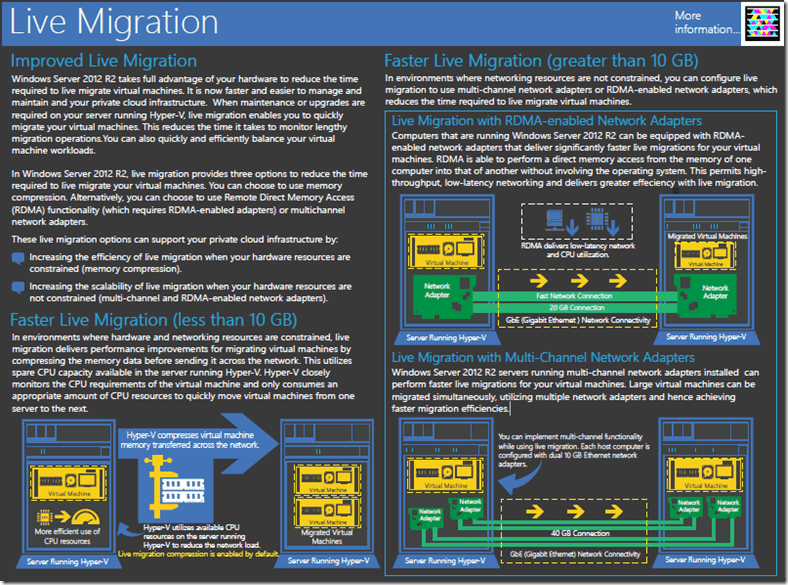

Posters de la Arquitectura de Windows Server 2012 R2 Hyper-V.

Micrososft ha publicado recientemente unos posters con la arquitectura y diseño del nuevo Windows Server 2012 R2 Hyper-V que hoy mismo dará el pistoletazo inicial de salida al mercado.

Los podemos descargar desde este link y nos incluye esta serié de documentos:

- Generación 2 de Máquinas virtuales.

- Hyper-V Failover Clustering.

- Hyper-V Storage.

- Hyper-v Virtual Hard Disk Sharing

- Live MIgration.

- Session Modes

- Upgrade Private Cloud

- Windows Server 2012 R2 Hyper-V components Architecture.

Para los mas profanos que no entendais bien determinados conceptos como Live Migration, Tombstone Reanimation, xxxx, os dejo este otro link del blog de Vegi Bit donde lo explica todo bastante bien en su post 3 conceptos de administración de Windows Server 2012.

Espero que os sea util.

Un saludo,

Hyper-V Performance – Parte V – NUMA.

Para finalizar esta serie de Post hoy nos metemos con NUMA. Hago una breve introducción sobre esta serie de posts sobre Hyper-V Performance. Hemos hablado de los siguientes puntos:

- CPU.

- Memoria.

- Almacenamiento.

- Red.

Creo que primero trataremos de explicar qué es NUMA y para qué sirve. Si buscamos la definición canónica de NUMA, desde la Wikipedia nos dice que es «El acceso a memoria no uniforme». Yo me quedé como estaba y seguí buscando por internet.

Al final me quedo con esta difinición. «Sistema que realiza una asociación de memoria de uso a CPU con la finalidad de evitar cuellos de botella». Aqui os dejo un enorme post sobre Numa e Hyper-V, del gran Daniel Matey. Es de hace un par de años pero poco han cambiado las cosas.

Al final me quedo con esta difinición. «Sistema que realiza una asociación de memoria de uso a CPU con la finalidad de evitar cuellos de botella». Aqui os dejo un enorme post sobre Numa e Hyper-V, del gran Daniel Matey. Es de hace un par de años pero poco han cambiado las cosas.

Un detalle que me llamó la atención es como realiza la asociación CPU vs Memoria cada constructor. Como ejemplo:

- Intel.- Asocia cada 4 Cores = 1 Nodo NUMA.

- AMD.- Asocia cada 6 Cores = 1 Nodo NUMA.

Hyper-V, automáticamente utilizará la mejor opción posible y configurará la máquina virtual (VM) para optimizar la topologia existente NUMA. Los problemas aparecen cuando utilizamos memoria dinámica y cuando las VMs requieren mas memoria que la asignada a cada nodo NUMA.

Ahora, a lo nuestro, verificar y medir el rendimiento:

- \\Hyper-V Hypervisor Virtual Processor(*)\% Remote RunTime.- El menor valor representará un buen rendimiento. Cuanto mas cercano a 0 mucho mejor.

- \\Hyper-V VM VID Partition(*)\% Remote Physical Pages.- Lo ideal es que esté lo mas cercano posible a 0. Esto quiere decir que la VM estará utilizando únicamente recursos locales, de su nodo NUMA.

Otras recomendaciones que realiza Microsoft:

- Los Componentes de integración (ICS) tienen que ser los recomendados/sugeridos dependiendo de la versión de Hyper-V donde esté alojada la VM.

- Hyper-V debería ser el único rol habilitado en el Host.

- Evitar tener una mezca del VMs con sus ICS y VM sin sus ICS, penalizará el rendimiento del Host.

- No asignar mas de 2 procesadores a aquellas VM con sistema operativo 2003. (Esta me ha gustado mucho).

- Por favor, no usuar «legacy network adapters» aumenta considerablemente el «Context Switching». Lo explicamos en el Post sobre red.

Ya queda menos.

Bibliografía.

Crear un USB de arranque automático con Hyper-V Server 2012 R2.

MI intención es tener un USB de andar por casa, 8GB, mas o menos, con una instalación de arranque automático con Hyper-V Server 2012 R2, vamos, lo último de lo último. O sea, tener un laboratorio casero con poco desembolso.

MI intención es tener un USB de andar por casa, 8GB, mas o menos, con una instalación de arranque automático con Hyper-V Server 2012 R2, vamos, lo último de lo último. O sea, tener un laboratorio casero con poco desembolso.

No he encontrado casi nada navegando por la Internet sobre este asunto, me refiero a la utilización de la versión R2, ya que todavía está calentita, así que he utilizado posts de versiones mas antiguas de Hyper-V.

El mejor post en castellano es para Soporte sin errores de Luisa cinque.

Y luego tenemos otros en ingles, el oficial de Technet y el del blog de Altaro suelen ser muy buenos:

Poco puedo aportar a estos pedazo de posts, así que simplifico al máximo:

Requisitos;

- USB de 8 GB o superior. Formateado en NTFS y como Partición Activa.

- Necesitamos tener instalado Windows Automated Installation Kit for Windows 7 (WAIK) que lo podemos descar de este link.

- Descargarnos Hyper-V Server 2012 R2 desde aqui.

- Ejecutarlo en un Windows 7 o superior.

- Ejecutarlo como administrador local

Pasos a seguir: Muy básico.

- Creamos, montamos y formateamos un disco virtual vhd.

- Aplicamos la imagen de Hyper-V Server 2012 R2 sobre dicho disco virtual. En nuestro caso el valor es 1.

- Prepararemos el USB, formateándolo y asignandole una unidad.

- Actualizaremos el Master Boot Record (MBR) del USB mediante BOOTSect.

- Copiaremos ficheros necesarios para que el USB pueda se de auto-arranque mediante BCDBOOT.

- Eliminaremos el fichero de paginación del USB.

Existen otras formas de hacerlo utilizando programas para tal fin, como los siguientes:

Create Hyper-V Server USB Memory

Desde Codeplex tenemos como siempre grandes sorpresas y esta es una de ellas. Aunque, en principio, está creada para Windows 2008 R2, también está soportada para Hyper-V Server 2012. Tenemos una serie de requerimientos:

- USB de 16 GB o superior. Formateado en NTFS y como Partición Activa.

- Necesitamos tener instalado Windows Automated Installation Kit for Windows 7 (WAIK) que lo podemos descar de este link.

- Descargarnos Hyper-V Server 2012 R2 desde aqui (hasta el próximo 17 de octubre)

- Ejecutarlo en un Windows 7 o superior.

- Ejecutarlo como administrador local

- .Net Framework 3.5

Para poner la partición como áctiva, en el caso de no estarlo:

C:\Users\ronin>diskpart

- *DISKPART> list disk

- * disk state size

- ###

- ——– ————- ——-

- disk 0 online 111 GB

- disk 1 online 30 GB

- *DISKPART> select disk 1

- *DISKPART> select partition 1

- *DISKPART> active

- *DISKPART> exit

BootFromUSB.

Esta otra opción la podemos descargar desde MSDN. Requerimientos:

- Ejecutar todo el proceso como administrador local.

- USB de 8GB o mas grande.

- Necesitamos tener instalado Windows Automated Installation Kit for Windows 7 (WAIK) que lo podemos descar de este link.

- Descargarnos Hyper-V Server 2012 R2 desde aqui (hasta el próximo 17 de octubre)

- Ejecutarlo en un Windows 7 o superior.

- .Net Framework 3.5.

Espero que os gusten. Si encontrais otras formas de hacerlo, no dudes en ilustrarme.

Buen fin de semana.

Proyecto Hyper-V. Fin de las hostilidades. Resource Pools en Hyper-V.

La semana pasada me informaron sobre la finalización del proyecto de implementación de Hyper-V en mi empresa, por segunda vez. Malas noticias para empezar la vuelta al cole, así que me quedo con un montón de post preparados para enseñaros, muchos de ellos terminados, que iré poniendo a lo largo de las próximas semanas.

Bastante decepcionado, como no, pero bueno, al menos se acabaran las hostilidades respecto a este gran producto que, poco a poco, se está situando en lo más alto del mundo de la virtualización. Ya sabeis que la ignorancia es uno de los grandes males de nuestra sociedad.

Hoy empiezo terminando (que raro suena), con Resource Pools en Hyper-V:

En Windows Server 2012 e Hyper-V Server 2012 nos aparece una nueva característica con vista a la agrupación de recursos para asignarlos y medirlos mas facilmente, los Grupos de recursos o Resource Pools.

La idea o filosofía de un Resource Pool es agrupar determinados recursos físicos, en algo que denominaremos «Pool», para ponerlos a disposición de las máquinas virtuales (VM), que serán nuestros clientes. Los tipos de recursos que ponemos a disposición en un Pool son los siguientes:

- Memoria.

- Procesador

- Ehternet

- VHD

- ISOs

- Virtual Floppy Disks (VFD).

- Fibre Channel Ports

- Fibre Channel connections

Para crear los Resource Pools solo lo podemos hacer a través de nuestra querida Powershell, aunque, tál vez, en la versión R2 todo esto venga integrado en la consola de Hyper-V. Tenía pensado poner un par de ejemplos, pero ….. a los hechos me remito. Lo siento.

Ejemplo 1: ResoucePool de ISO.

Ejemplo 2: ResoucePool de Red.

Os dejo unos links muy interesantes:

Si me gustaría empezar el mes que viene desde cero, sin nada pendiente, con muchas ganas de contar muchas cosas, sobre todo, nuevas, increibles y bonitas.

Buena semana a todos.

Que tiene de nuevo Hyper-V en Windows Server 2012 R2?

Bueno, despues de haber visto videos y presentaciones del TechEd del pasado mes en Madrid, os dejo estos links sobre «Qué tiene de nuevo Hyper-V (What’s New in…), Failover Cluster y Powershell 4.0.

- What’s New in Hyper-V in Windows Server 2012 R2.

- What’s New in Failover Clustering in Windows Server 2012 R2.

- What’s New in PowerShell 4.0.

Os dejo este video de Channel9 y la PPT de rigor.

Espero que os gusten.

Saludos robeznos.

Afinar la configuración de nuestro Cluster Hyper-V Windows 2012. Preferred Owners o Nodos preferidos a traves de Powershell.

Como continuación al Post del viernes pasado (este), sobre la afinación en la configuración de nuestro Cluster Hyper-V Windows 2012, dejamos pendiente la configuración a través de Powershell.

Allá vamos. Lo dividiremos en varias partes, debido a su amplitud,, Preferred Owners, Proceso de Failover, Mejoras en el Orden de arranque de las VM y Reglas de Afinidad y Antiafinidad.

.

PREFERRED OWNERS

Partimos desde el punto de que ya tenemos instalado nuestro Cluster de Windows Server 2012 con el Rol de Hyper-V, por lo tanto, al instalar la RSAT, nos cargaría el módulo de PowerShell para FailoverCluster:

1.- Ordenamos los elementos del Cluster.-

1.- Ordenamos los elementos del Cluster.-

Get-ClusterGroup

2.- Ordenamos los elementos del Cluster dependiendo del propietario.-

Get-ClusterGroup | Get-ClusterOwnerNode

Donde vemos los Host preferidos para las VMA y VMB, así como los recursos del Cluster Group y Available Storage .

3.- Asignamos un propietario preferido, el Host A, a una VM por ejemplo a la VMA:

Get-ClusterGroup VMA | Set-ClusterOwnerNode HOST_A

y comprobamos que el recuros VMA tiene su Owner en el Host A:

Si queremos volver a quitar los Preferred Owners de la máquina virtual VMA, sin ningún problema:

Get-ClusterGroup VMA | Set-ClusterOwnerNode «»

Bibliografia